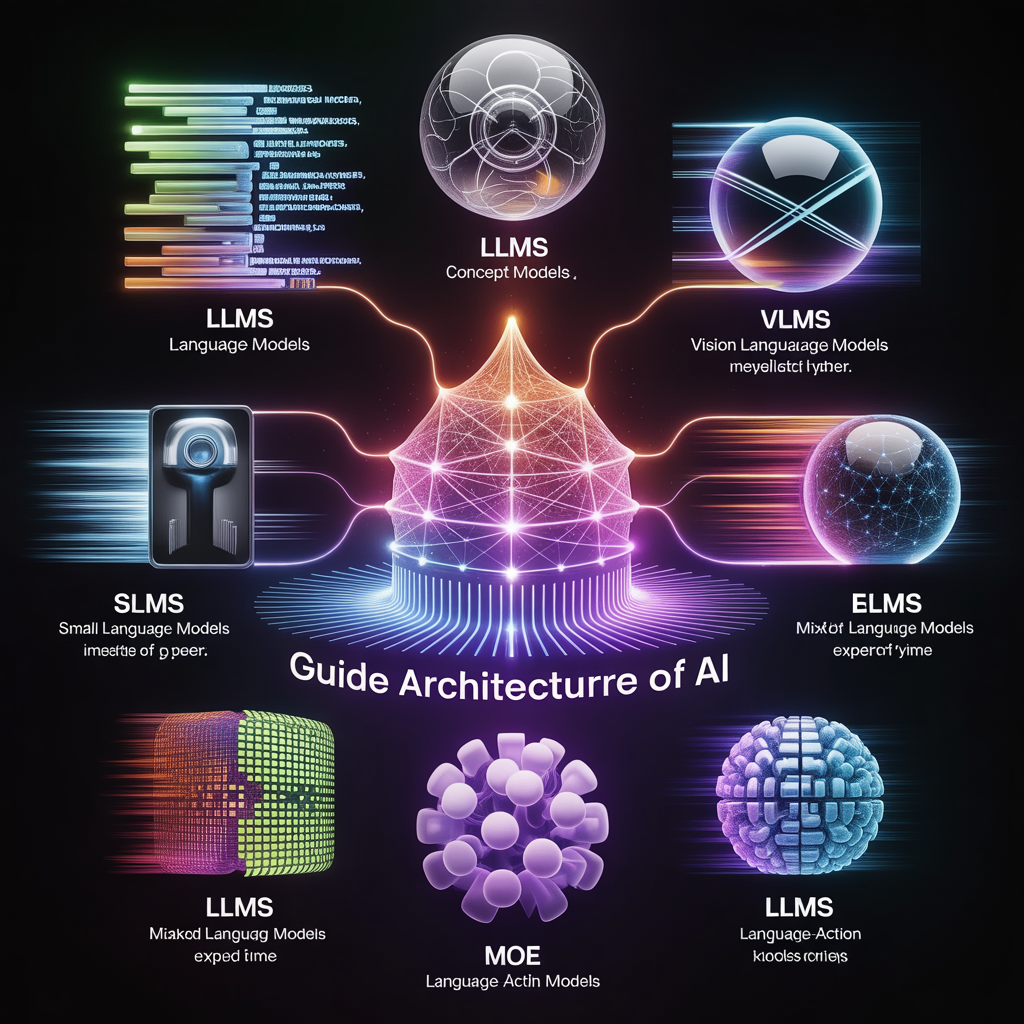

Au-Delà du Texte : Guide Architectural des 8 Modèles d’IA Spécialisés – De la Sémantique à l’Action et à la Vision

Introduction : Le Paysage Architectural de l’IA

L’intelligence artificielle générative a captivé l’imagination collective, propulsée par l’ascension fulgurante des Large Language Models (LLMs). Ces modèles, maîtres incontestés de la génération de texte et du raisonnement linguistique, ont redéfini les frontières de l’interaction homme-machine. Cependant, l’écosystème de l’IA est bien plus vaste et nuancé qu’une simple conversation textuelle. La réalité est que les LLMs ne représentent qu’une fraction, bien que spectaculaire, de l’ingénierie neuronale contemporaine. L’innovation la plus profonde réside dans la spécialisation architecturale, où des modèles sont conçus avec une précision chirurgicale pour exceller dans des domaines spécifiques : de la perception visuelle ultra-fine à l’exécution d’actions complexes dans le monde réel, en passant par l’optimisation des ressources et la compréhension conceptuelle.

1.1. Le LLM comme Point de Départ : Limites et Spécialisation

Le succès des LLMs repose sur leur capacité à prédire le prochain jeton (token) avec une précision remarquable, leur conférant des propriétés émergentes de raisonnement et de connaissance. Néanmoins, cette architecture généraliste présente des limites intrinsèques. Leur dépendance à la tokenisation du texte peut masquer la sémantique de haut niveau, et leur taille colossale les rend inefficaces pour le déploiement sur des appareils à ressources limitées. De plus, par nature, ils sont passifs : ils génèrent du texte mais ne peuvent pas interagir directement avec un environnement extérieur. C’est dans ces lacunes que la nécessité de la spécialisation architecturale prend tout son sens. L’évolution de l’IA est désormais dictée par la convergence de l’échelle et de la spécificité fonctionnelle.

1.2. Taxonomie des Modèles d’IA : Vitesse, Taille et Multimodalité

Pour naviguer dans ce paysage complexe, il est essentiel d’établir une taxonomie basée sur les compromis fondamentaux qui guident la conception des modèles :

| Compromis Architectural | Description | Architectures Concernées |

| Taille vs. Efficacité | Optimisation du nombre de paramètres pour la vitesse d’inférence et le coût de déploiement. | LLMs, SLMs, MoE |

| Unimodalité vs. Multimodalité | Capacité à traiter et à fusionner différents types de données (texte, image, action). | LLMs, VLMs, SAMs, LAMs |

| Token vs. Concept | Niveau de granularité de la représentation interne des données. | LLMs, MLMs, LCMs |

Ces huit architectures spécialisées – LCMs, VLMs, SLMs, MoE, MLMs, LAMs, SAMs, LLMs – illustrent la diversification des objectifs de l’IA, chacun étant une réponse optimisée à un défi computationnel ou applicatif précis.

1.3. Public Cible et Objectifs du Guide

Ce guide s’adresse aux chercheurs en IA, aux ingénieurs en apprentissage automatique (Machine Learning Engineers), et aux académiques désireux d’approfondir leur compréhension des fondements architecturaux au-delà des connaissances généralistes. L’objectif est de fournir une analyse technique et conceptuelle rigoureuse, permettant au lecteur de :

1.Distinguer les principes de conception de chaque architecture.

2.Comprendre les mécanismes d’entraînement et les avantages opérationnels.

3.Évaluer les implications pour les applications de pointe et la recherche future.

Chapitre 1 : Les Fondations du Langage (MLMs et LLMs)

Avant d’explorer les modèles spécialisés, il est impératif de consolider la compréhension des architectures de langage qui ont servi de tremplin à l’ère générative.

2.1. MLMs (Masked Language Models) : Les Pionniers du Contexte

Les MLMs représentent la première génération de modèles de langage basés sur l’architecture Transformer qui ont véritablement exploité le contexte bidirectionnel.

2.1.1. Principe du Masquage et Entraînement Bidirectionnel (ex: BERT)

Contrairement aux modèles précédents (comme les RNN ou les premiers Transformers) qui traitaient le texte de manière unidirectionnelle (de gauche à droite), les MLMs comme BERT (Bidirectional Encoder Representations from Transformers) ont introduit la tâche de modélisation du langage masqué (Masked Language Modeling). Le principe est simple mais puissant : un certain pourcentage des jetons d’entrée est masqué aléatoirement, et le modèle est entraîné à prédire les jetons originaux en se basant sur le contexte à la fois gauche et droit [1]. Cette approche bidirectionnelle permet au modèle de construire une représentation sémantique riche et contextuelle de chaque mot, essentielle pour les tâches de compréhension du langage naturel (NLU).

2.1.2. Architecture Transformer : Mécanismes d’Attention

L’épine dorsale des MLMs est l’encodeur Transformer. Le mécanisme clé est l’auto-attention multi-têtes (Multi-Head Self-Attention), qui permet au modèle de pondérer l’importance de chaque autre jeton dans la séquence d’entrée lors du traitement d’un jeton donné. Mathématiquement, cela se traduit par le calcul de scores de similarité entre les vecteurs de Requête (Query), Clé (Key) et Valeur (Value) dérivés des intégrations de jetons. L’encodeur Transformer est empilé en plusieurs couches, permettant une abstraction progressive des caractéristiques linguistiques.

2.1.3. Rôle Historique et Transition vers les Modèles Génératifs

Les MLMs ont dominé l’ère de la compréhension du langage naturel (NLU), excellant dans des tâches telles que la classification de texte, la reconnaissance d’entités nommées et la réponse aux questions. Cependant, leur architecture d’encodeur pur les rend moins adaptés à la génération de langage naturel (NLG), qui nécessite une structure auto-régressive. Cette limitation a marqué la transition vers les architectures de type décodeur-seul ou encodeur-décodeur qui sont au cœur des LLMs.

2.2. LLMs (Large Language Models) : Texte et Raisonnement à Grande Échelle

Les LLMs sont l’aboutissement de l’architecture Transformer, caractérisés par leur échelle massive (milliards de paramètres) et leur capacité à générer un texte cohérent et contextuellement pertinent.

2.2.1. Architecture Décodage-Seul et Auto-Régression

La majorité des LLMs modernes (comme GPT-3/4, Llama) utilisent une architecture de décodeur-seul. Le processus est auto-régressif : le modèle génère un jeton à la fois, et ce jeton généré est ensuite réintroduit dans le modèle comme entrée pour la prédiction du jeton suivant. Crucialement, le mécanisme d’attention dans le décodeur est masqué pour empêcher le modèle de « tricher » en regardant les jetons futurs, assurant ainsi une génération séquentielle et naturelle.

2.2.2. Techniques d’Alignement (RLHF, DPO)

L’étape de pré-entraînement sur des téraoctets de données textuelles confère aux LLMs leurs vastes connaissances. Cependant, pour aligner leur comportement sur les intentions humaines (utilité, honnêteté, inoffensivité), des techniques d’alignement sont appliquées.

•RLHF (Reinforcement Learning from Human Feedback) : Implique l’entraînement d’un modèle de récompense (Reward Model) basé sur des comparaisons de réponses humaines, puis l’utilisation de l’apprentissage par renforcement (PPO) pour affiner le LLM.

•DPO (Direct Preference Optimization) : Une méthode plus récente et plus simple qui optimise directement la politique du modèle pour maximiser la probabilité des réponses préférées par les humains, sans nécessiter un modèle de récompense explicite.

2.2.3. Capacités de Raisonnement et Limites Inhérentes

Les LLMs démontrent des capacités de raisonnement en chaîne de pensée (Chain-of-Thought) et de résolution de problèmes complexes. Ces capacités émergentes sont souvent attribuées à l’échelle du modèle. Cependant, ils restent fondamentalement des machines à prédire des jetons. Leurs limites incluent les hallucinations (génération d’informations factuellement incorrectes) et la difficulté à intégrer des informations en temps réel ou à interagir avec des systèmes externes de manière fiable. Ces limites sont précisément ce qui motive le développement des architectures spécialisées abordées dans les chapitres suivants.

Fin du Chapitre 1. Le guide continuera avec les Chapitres 2, 3 et 4, suivis de la Conclusion et des Références.

Chapitre 2 : Optimisation et Efficacité (SLMs et MoE)

L’ère des LLMs a mis en lumière un dilemme fondamental : la performance brute est souvent corrélée à la taille du modèle, ce qui entraîne des coûts d’entraînement et d’inférence prohibitifs. Les architectures SLMs et MoE sont des réponses directes à ce défi, visant à optimiser l’efficacité sans sacrifier la capacité.

3.1. SLMs (Small Language Models) : L’Efficacité à l’Échelle

Les Small Language Models (SLMs) sont des modèles de langage conçus pour offrir des performances compétitives tout en étant significativement plus petits que leurs homologues LLMs. Leur objectif principal est de permettre un déploiement plus large, notamment sur des appareils edge ou dans des environnements à faible latence.

3.1.1. Techniques de Distillation et de Quantization

L’efficacité des SLMs est souvent atteinte par des techniques de compression :

•Distillation des connaissances (Knowledge Distillation) : Un grand modèle (le « professeur ») est utilisé pour entraîner un modèle plus petit (l' »étudiant »). L’étudiant apprend non seulement à reproduire les prédictions du professeur, mais aussi la distribution de probabilité des classes (les « soft targets »), capturant ainsi une partie de la richesse du modèle plus grand.

•Quantization : Réduction de la précision numérique des poids du modèle (par exemple, de 32 bits à 8 bits ou 4 bits). Cela réduit la taille de la mémoire et accélère les calculs, bien que cela puisse introduire une légère perte de précision.

3.1.2. Compromis Taille-Performance pour le Déploiement Edge

Le principal avantage des SLMs réside dans le compromis optimisé entre la taille et la performance. Un SLM bien conçu peut surpasser un LLM mal optimisé sur des tâches spécifiques, tout en nécessitant une fraction des ressources. Cela est crucial pour le déploiement embarqué (edge deployment), où la puissance de calcul, la mémoire et la consommation d’énergie sont des contraintes majeures.

3.1.3. Applications en Inférence à Faible Latence

Les SLMs sont idéaux pour les applications nécessitant une réponse quasi instantanée, telles que les assistants vocaux sur appareil, la modération de contenu en temps réel ou les systèmes de recommandation intégrés. Leur petite taille permet de charger le modèle en mémoire plus rapidement et de réduire la latence d’inférence.

3.2. MoE (Mixture of Experts) : Le Parallelisme Conditionnel

L’architecture Mixture of Experts (MoE) est une approche novatrice pour augmenter la capacité d’un modèle sans augmenter proportionnellement le coût de calcul par jeton. Elle permet de créer des modèles avec un nombre colossal de paramètres, dont seule une petite fraction est activée pour chaque inférence.

3.2.1. Architecture de Gating et Routage des Tokens

Un modèle MoE se compose de plusieurs sous-réseaux appelés Experts (généralement des blocs de feed-forward). Un réseau de Gating (ou Router) apprend à déterminer quels experts sont les plus pertinents pour un jeton d’entrée donné. Pour chaque jeton, le Router sélectionne et active typiquement seulement un ou deux experts.

Plain Text

\text{Sortie} = \sum_{i=1}^{N} g_i(x) E_i(x)

Où $g_i(x)$ est le poids donné par le réseau de Gating pour l’Expert $E_i$, et $N$ est le nombre total d’experts.

3.2.2. Avantages en Entraînement et en Capacité Modèle

L’avantage majeur du MoE est qu’il permet d’augmenter la capacité totale du modèle (le nombre total de paramètres) sans augmenter significativement le coût de calcul (FLOPs) par inférence. Un modèle MoE avec des milliers de milliards de paramètres peut être entraîné et exécuté avec la même quantité de ressources qu’un modèle dense de quelques milliards de paramètres, car seule une partie des experts est sollicitée. Cela se traduit par une meilleure performance pour un budget de calcul donné.

3.2.3. Défis d’Implémentation et de Déploiement

L’implémentation des MoE présente des défis, notamment la nécessité d’une infrastructure de calcul distribué sophistiquée pour gérer le routage des jetons vers différents experts. De plus, le Router doit être entraîné pour assurer une charge équilibrée entre les experts, afin d’éviter que certains experts ne soient sur-sollicités.

Chapitre 3 : L’Ère de la Multimodalité et du Concept

Alors que les Chapitres 1 et 2 se concentraient sur le texte et l’efficacité, le Chapitre 3 explore comment l’IA s’affranchit de la seule modalité textuelle pour intégrer la vision et élever la représentation sémantique au niveau du concept.

4.1. VLMs (Vision-Language Models) : Fusionner la Vue et le Texte

Les Vision-Language Models (VLMs) sont conçus pour traiter et comprendre des informations provenant de deux modalités distinctes : l’image (vision) et le texte (langage).

4.1.1. Architectures de Fusion (Early, Late, Cross-Attention)

La clé de l’efficacité d’un VLM réside dans la manière dont les informations visuelles et textuelles sont fusionnées :

•Fusion Précoce (Early Fusion) : Les intégrations (embeddings) des deux modalités sont concaténées très tôt dans le réseau.

•Fusion Tardive (Late Fusion) : Les modalités sont traitées séparément par des encodeurs dédiés, et la fusion n’a lieu qu’à la fin pour la tâche spécifique.

•Attention Croisée (Cross-Attention) : L’approche la plus courante, où les mécanismes d’attention permettent aux jetons d’une modalité de s’interroger sur les jetons de l’autre modalité, facilitant une compréhension contextuelle mutuelle.

4.1.2. Alignement des Espaces d’Intégration (Embeddings)

Un défi majeur est d’aligner les espaces d’intégration des encodeurs de vision et de langage. Des modèles comme CLIP (Contrastive Language-Image Pre-training) utilisent l’apprentissage contrastif pour s’assurer que les paires image-texte sémantiquement similaires sont rapprochées dans l’espace d’intégration, permettant une compréhension zero-shot des concepts visuels.

4.1.3. Applications : Captioning, VQA (Visual Question Answering)

Les VLMs sont au cœur d’applications multimodales :

•Image Captioning : Génération de descriptions textuelles précises pour des images.

•Visual Question Answering (VQA) : Répondre à des questions posées en langage naturel sur le contenu d’une image.

4.2. LCMs (Large Concept Models) : Le Saut Sémantique (Meta SONAR)

Les Large Concept Models (LCMs), notamment ceux développés par Meta et basés sur l’architecture SONAR, proposent une rupture avec la tokenisation traditionnelle en se concentrant sur la représentation de concepts de niveau supérieur.

4.2.1. Architecture SONAR : Représentations de Concepts de Niveau Supérieur

L’architecture SONAR (Sentence-level Multimodal and Language-agnostic Representations) génère des intégrations de phrases de taille fixe, multilingues et multimodales. Au lieu de traiter des jetons individuels, les LCMs opèrent dans cet espace de représentation sémantique dense. Cela permet au modèle de raisonner et de traiter l’information non pas au niveau de la syntaxe ou du mot, mais au niveau du concept ou de la phrase complète.

4.2.2. Différence Fondamentale avec la Tokenisation des LLMs

Alors que les LLMs manipulent des séquences de jetons (souvent des sous-mots) pour construire le sens, les LCMs travaillent directement avec des vecteurs qui encapsulent le sens global d’une idée ou d’une phrase. Cette approche réduit la dépendance à la longueur de la séquence et améliore la robustesse face aux variations linguistiques et aux ambiguïtés de bas niveau.

4.2.3. Impact sur la Recherche Sémantique et le Raisonnement Conceptuel

Les LCMs sont particulièrement prometteurs pour la recherche sémantique et la comparaison de documents à grande échelle, car ils peuvent comparer le sens de deux phrases ou documents indépendamment de leur formulation exacte. Ils ouvrent la voie à un raisonnement plus abstrait et conceptuel, potentiellement moins sujet aux erreurs de surface que les LLMs basés sur la prédiction de jetons.

Fin du Chapitre 3. Le guide continuera avec le Chapitre 4, la Conclusion et les Références.

Chapitre 4 : L’IA dans l’Action et la Perception Fine

Les architectures présentées dans ce chapitre représentent la frontière de l’IA appliquée, où les modèles ne se contentent plus de comprendre ou de générer, mais agissent sur le monde (LAMs) ou le perçoivent avec une granularité sans précédent (SAMs).

5.1. LAMs (Language-Action Models) : L’Agent Autonome

Les Language-Action Models (LAMs) sont une évolution des LLMs qui intègrent la capacité d’exécuter des actions dans un environnement numérique ou physique. Ils sont la pierre angulaire de l’IA agentique.

5.1.1. Intégration du LLM avec les Planificateurs et les Outils (Tool Use)

Le cœur d’un LAM est un LLM qui sert de planificateur et de raisonneur. Il traduit l’intention de l’utilisateur (exprimée en langage naturel) en une séquence d’actions discrètes. Ces actions sont exécutées via des outils (Tools), qui peuvent être des API, des fonctions de code, ou des interfaces de programmation d’applications (APIs) web. L’architecture typique implique :

1.Compréhension de l’Intention : Le LLM analyse la requête.

2.Planification : Le LLM génère un plan étape par étape.

3.Sélection d’Outil : Le LLM choisit l’outil approprié pour l’étape actuelle.

4.Exécution : L’outil est appelé, et son résultat est renvoyé au LLM.

5.1.2. Architecture de Boucle de Rétroaction et Apprentissage par Renforcement

Ce processus s’inscrit souvent dans une boucle de rétroaction (ou agent loop). Le résultat de l’action est une nouvelle observation de l’environnement, que le LAM utilise pour ajuster son plan ou déterminer l’action suivante. L’entraînement des LAMs peut impliquer l’Apprentissage par Renforcement (Reinforcement Learning) pour optimiser la politique d’action en fonction des récompenses obtenues par la réussite des tâches.

5.1.3. Applications : Automatisation de Tâches Complexes et Robotique

Les LAMs sont essentiels pour l’automatisation de flux de travail complexes (ex: gestion de bases de données, interaction avec des applications SaaS) et sont le moteur des systèmes de robotique qui nécessitent une planification de haut niveau basée sur des commandes en langage naturel.

5.2. SAMs (Segment Anything Models) : La Segmentation Universelle

Le Segment Anything Model (SAM) de Meta AI a révolutionné la segmentation d’images en introduisant un modèle capable de généraliser à de nouveaux objets et de nouvelles images sans nécessiter de ré-entraînement spécifique.

5.2.1. Architecture à Trois Composants : Encodeur d’Image, Encodeur de Prompt, Décodeur de Masque

L’architecture de SAM est élégamment divisée en trois modules distincts :

1.Encodeur d’Image (Image Encoder) : Un transformateur visuel (ViT) qui traite l’image d’entrée pour générer une intégration d’image unique et riche en informations.

2.Encodeur de Prompt (Prompt Encoder) : Traite les invites (prompts) qui peuvent être des points, des boîtes englobantes, ou du texte. Ces invites guident le modèle vers l’objet à segmenter.

3.Décodeur de Masque (Mask Decoder) : Un décodeur léger qui combine l’intégration d’image (du ViT) et l’intégration de prompt pour prédire un masque de segmentation.

5.2.2. Le Paradigme du « Zero-Shot Generalization »

SAM a été entraîné sur le jeu de données massif SA-1B (plus d’un milliard de masques sur 11 millions d’images). Cette échelle d’entraînement lui confère une capacité de généralisation zero-shot exceptionnelle. Le modèle peut segmenter des objets qu’il n’a jamais vus, simplement en se basant sur une invite minimale, le rendant universellement applicable à n’importe quelle tâche de segmentation.

5.2.3. Entraînement sur le Jeu de Données SA-1B et Implications pour la Vision par Ordinateur

L’impact de SAM est comparable à celui de GPT-3 pour le langage. Il standardise la segmentation et permet aux chercheurs et aux développeurs de se concentrer sur des tâches de niveau supérieur, en utilisant SAM comme un composant de base pour la perception visuelle.

Conclusion : Synthèse et Perspectives Futures

L’évolution de l’intelligence artificielle est un mouvement constant de généralisation et de spécialisation. Les LLMs ont prouvé la puissance de l’échelle, mais l’avenir est clairement aux architectures optimisées pour des objectifs précis.

6.1. Tableau Comparatif des 8 Architectures : Objectif, Compromis, et Public

Le tableau suivant synthétise les caractéristiques clés des huit architectures analysées, mettant en évidence leurs objectifs de conception et leurs compromis.

| Architecture | Objectif Principal | Compromis Clé | Exemple d’Outil/Modèle |

| LLMs | Génération de texte, Raisonnement Linguistique | Taille vs. Coût d’inférence | GPT-4, Llama 3 |

| MLMs | Compréhension Contextuelle Bidirectionnelle | Génération vs. Compréhension | BERT, RoBERTa |

| SLMs | Efficacité, Déploiement sur Appareil (Edge) | Taille vs. Capacité générale | Phi-3, Gemma 2B |

| MoE | Augmentation de la Capacité sans Augmenter le Coût de Calcul | Densité vs. Complexité du routage | Mixtral 8x7B, Switch Transformer |

| VLMs | Compréhension et Génération Multimodales (Vision + Langage) | Alignement des espaces d’intégration | CLIP, GPT-4V |

| LCMs | Représentation et Raisonnement au niveau du Concept | Tokenisation vs. Sémantique de haut niveau | Meta SONAR |

| LAMs | Exécution d’Actions, Agentivité | Langage vs. Interaction avec l’environnement | Modèles basés sur ReAct, AutoGPT |

| SAMs | Segmentation d’Image Universelle (Zero-Shot) | Précision vs. Généralisation | Segment Anything Model (SAM) |

6.2. Les Synergies Architecturales : Vers des Modèles Hybrides

L’avenir de l’intelligence artificielle ne réside pas dans la domination d’une seule architecture, mais dans leur synergie fonctionnelle. Les systèmes d’IA modernes tendent vers des modèles hybrides où chaque composant architectural est sélectionné pour son excellence dans une tâche spécifique, créant une chaîne de valeur optimisée. Cette approche modulaire permet de dépasser les limites intrinsèques de chaque modèle pris isolément.

6.2.1. Le Modèle Agentique (LAM + LLM + VLM + SLM)

L’exemple le plus probant de synergie est le modèle agentique (ou agent loop), dont le LAM est la pierre angulaire.

•LLM (Raisonnement) : Sert de cerveau central pour la planification de haut niveau, la décomposition des tâches complexes et la traduction de l’intention humaine en étapes logiques.

•LAM (Action) : Exécute les étapes planifiées en interagissant avec des outils externes (APIs, interfaces utilisateur).

•VLM (Perception) : Est utilisé pour interpréter l’état de l’environnement (par exemple, analyser une capture d’écran d’une application web pour localiser un bouton ou un champ de texte), fournissant un retour visuel essentiel au LLM pour la planification.

•SLM (Efficacité) : Peut être intégré pour des tâches de classification ou de filtrage rapides et locales, réduisant la latence et le coût d’inférence du LLM principal.

6.2.2. Optimisation de la Connaissance (LCM + LLM + MoE)

L’intégration des LCMs et des MoE avec les LLMs vise à optimiser la qualité et l’efficacité du raisonnement :

•LCMs (Sémantique) : Peuvent être utilisés comme un filtre ou un module de vérification factuelle. Après qu’un LLM ait généré une réponse, un LCM peut évaluer la cohérence conceptuelle de la sortie en la comparant à une base de connaissances conceptuelle, réduisant ainsi les hallucinations.

•MoE (Échelle Efficace) : Les LLMs eux-mêmes sont de plus en plus souvent construits sur une architecture MoE. Cela permet au modèle de maintenir une capacité de raisonnement massive (grâce au grand nombre de paramètres) tout en conservant une vitesse d’inférence acceptable (grâce à l’activation conditionnelle des experts).

6.2.3. L’Amélioration de la Perception (SAM + VLM)

Dans le domaine de la vision, le SAM est souvent utilisé comme un outil de pré-traitement pour les VLMs.

•Un VLM peut recevoir une image et une requête textuelle. Pour répondre, il peut d’abord invoquer le SAM pour segmenter tous les objets pertinents dans l’image.

•Le VLM peut ensuite se concentrer uniquement sur les masques et les régions d’intérêt fournies par le SAM, améliorant la précision du raisonnement visuel (VQA) et réduisant l’ambiguïté.

En conclusion, la combinaison de ces architectures spécialisées permet de construire des systèmes d’IA qui sont à la fois intelligents (grâce aux LLMs/LCMs), efficaces (SLMs/MoE), perceptifs (VLMs/SAMs) et capables d’agir (LAMs). C’est cette modularité qui définit la prochaine génération de l’IA.

6.3. Conclusion Générale : Vers l’Intelligence Générale Spécialisée

Ce guide a démontré que l’ère de l’IA est entrée dans une phase de spécialisation architecturale sophistiquée. Si les LLMs ont servi de catalyseur, l’innovation se déploie désormais dans huit directions distinctes, chacune optimisée pour un compromis fondamental :

•Efficacité (SLMs, MoE) : Répondant aux impératifs de coût et de déploiement.

•Multimodalité et Concept (VLMs, LCMs, SAMs) : Élargissant la perception et le raisonnement au-delà du texte.

•Action (LAMs) : Comblant le fossé entre la cognition et l’exécution dans le monde réel.

Le point culminant de cette diversification est l’émergence des systèmes hybrides. Ces systèmes, comme l’agentique (LLM + LAM + VLM), exploitent la force de chaque architecture – le LLM pour la planification, le VLM pour la perception, le LAM pour l’exécution – pour créer une intelligence modulaire et résiliente.

Vision d’Avenir et Impératifs Éthiques :

L’avenir de l’IA ne sera pas défini par un seul modèle monolithique, mais par la convergence de ces architectures vers une Intelligence Générale Spécialisée. Les recherches prospectives sur les CLMs (Causalité) et les MEMs (Mémoire) indiquent que les prochains bonds technologiques se concentreront sur l’intégration de capacités cognitives de niveau humain.

Cependant, cette puissance modulaire s’accompagne de défis éthiques tout aussi spécialisés. Le risque d’hallucinations (LLMs) et de biais inhérent (MLMs) est amplifié par l’opacité des SLMs et la difficulté de traçabilité des MoE. Plus critiques encore sont les risques liés à l’autonomie des LAMs et au ciblage précis permis par les SAMs.

Pour les experts et les universitaires, la voie à suivre est double :

1.Maîtriser la Modularité : Comprendre comment combiner ces briques architecturales pour créer des solutions optimales.

2.Exiger l’Éthique Modulaire : Développer des cadres de gouvernance qui adressent les risques spécifiques de chaque composant, garantissant que l’évolution vers l’Intelligence Générale Spécialisée soit responsable et bénéfique pour la société.

La course n’est plus seulement à la taille, mais à la pertinence architecturale et à la responsabilité fonctionnelle. C’est dans cette intersection que se jouera la prochaine décennie de l’intelligence artificielle.

Références

[1] Devlin, J., Chang, M. W., Lee, K., & Toutanova, K. (2019). BERT: Pre-training of Deep Bidirectional Transformers for Language Understanding. Proceedings of NAACL-HLT. [2] Brown, T. B., Mann, B., Ryder, N., Subbiah, M., Kaplan, J., Dhariwal, P., … & Amodei, D. (2020). Language Models are Few-Shot Learners. Advances in Neural Information Processing Systems. [3] Touvron, H., Lavril, T., Izacard, G., Liskovich, X., Luccioni, A., & Bressand, H. (2023). Llama 2: Open Foundation and Fine-Tuned Chat Models. arXiv preprint arXiv:2307.09288. [4] Kirillov, A., Mintun, E., Scharstein, D., Han, H., Mao, Z., Wang, C., … & Girshick, R. (2023). Segment Anything. arXiv preprint arXiv:2304.02643. [5] Meta AI. (2024). Large Concept Models: Language Modeling in a Sentence Representation Space. Research Publication. [6] Radford, A., Wu, J., Child, R., Luan, D., Amodei, D., & Sutskever, I. (2019). Language Models are Unsupervised Multitask Learners. OpenAI Blog. [7] Rombach, S., Blattmann, A., Lorenz, D., Esser, P., & Ommer, B. (2022). High-Resolution Image Synthesis with Latent Diffusion Models. Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition. [8] Fedus, W., Zoph, B., & Shazeer, N. (2022). Switch Transformers: Scaling to Trillion Parameter Models with Constant Compute. Journal of Machine Learning Research. [9] Ouyang, L., Wu, J., Jiang, X., Almeida, D., Wainwright, C. L., Mishkin, P., … & Lowe, R. (2022). Training language models to follow instructions with human feedback. Advances in Neural Information Processing Systems. [10] Meta AI. (2023). SONAR: Sentence-Level Multimodal and Language-Agnostic Representations. Research Publication. [11] Yao, S., Zhao, H., Yu, S., Du, W., Shafran, I., Wen, Y., & Zhu, Y. (2023). ReAct: Synergizing Reasoning and Acting in Language Models. International Conference on Learning Representations. [12] Chen, M., Tworek, J., Jun, H., Yuan, Q., Liu, H., Zoph, B., … & Sutskever, I. (2021). Evaluating Large Language Models Trained on Code. International Conference on Learning Representations.