Comprendre les modèles d’IA et les agents d’IA

1. Fondamentaux de l’Intelligence Artificielle

L’intelligence artificielle (IA) est un domaine en constante évolution qui vise à créer des machines capables de simuler l’intelligence humaine. Cette section explore les définitions, l’historique, les types de modèles et les concepts clés qui sous-tendent cette discipline fascinante.

1.1. Définition et Historique de l’IA

Pour appréhender pleinement l’IA, il est essentiel de commencer par ses fondements, en définissant ce qu’elle est et en retraçant son parcours historique.

1.1.1. Qu’est-ce que l’Intelligence Artificielle ?

L’Intelligence Artificielle peut être définie comme la science et l’ingénierie de la fabrication de machines intelligentes, en particulier de programmes informatiques intelligents. Elle est liée à la tâche d’utiliser des ordinateurs pour comprendre l’intelligence humaine, mais elle n’est pas limitée aux méthodes biologiquement observables. En d’autres termes, l’IA cherche à doter les machines de capacités cognitives telles que l’apprentissage, le raisonnement, la résolution de problèmes, la perception et la compréhension du langage.

•Exemple : Un système de recommandation de films comme celui de Netflix est une forme d’IA. Il analyse vos préférences passées (films que vous avez regardés, notés) et celles d’utilisateurs similaires pour prédire les films que vous pourriez aimer, sans que cela ne soit explicitement programmé pour chaque film. Il apprend de vos interactions.

1.1.2. Jalons Historiques et Évolutions Clés

L’histoire de l’IA est jalonnée de périodes d’enthousiasme et de déceptions, souvent appelées « hivers de l’IA », mais elle a toujours progressé, menant aux avancées actuelles.

•Années 1950-1960 : Les Débuts et l’Optimisme

•1950 : Alan Turing propose le « Test de Turing » dans son article « Computing Machinery and Intelligence », posant la question fondamentale : « Les machines peuvent-elles penser ? »

•1956 : La conférence de Dartmouth, organisée par John McCarthy, est considérée comme l’acte de naissance officiel de l’IA en tant que discipline. Le terme « Intelligence Artificielle » y est inventé.

•Développement de programmes pionniers comme le Logic Theorist (résolution de problèmes logiques) et ELIZA (un chatbot rudimentaire).

•Années 1970-1980 : Les Systèmes Experts et le Premier Hiver de l’IA

•Systèmes Experts : Des programmes basés sur des règles et des connaissances humaines, utilisés dans des domaines spécifiques comme le diagnostic médical (MYCIN) ou la configuration d’ordinateurs (R1/XCON). Ils ont connu un succès commercial limité.

•Hiver de l’IA : Le manque de puissance de calcul, de données et les attentes irréalistes ont conduit à un désintérêt et à une réduction des financements.

•Années 1990-2000 : L’Apprentissage Automatique et la Renaissance

•Apprentissage Automatique (Machine Learning) : L’accent est mis sur les algorithmes qui apprennent à partir de données plutôt que sur la programmation explicite de règles. Des techniques comme les Machines à Vecteurs de Support (SVM) et les arbres de décision gagnent en popularité.

•1997 : Deep Blue d’IBM bat le champion du monde d’échecs Garry Kasparov, marquant un tournant.

•Années 2010 à Aujourd’hui : L’Apprentissage Profond et l’Explosion de l’IA

•Apprentissage Profond (Deep Learning) : L’avènement des réseaux de neurones profonds, combiné à l’augmentation massive de la puissance de calcul (GPU) et à la disponibilité de vastes ensembles de données, a révolutionné l’IA.

•2012 : AlexNet remporte le concours ImageNet avec une marge significative, prouvant la puissance des CNN pour la vision par ordinateur.

•2016 : AlphaGo de DeepMind bat le champion du monde de Go, un jeu bien plus complexe que les échecs pour l’IA.

•Développement des Transformers (2017) et des grands modèles de langage (LLM) comme GPT-3, qui ont ouvert la voie à des applications de génération de texte, de traduction et de conversation d’une qualité sans précédent.

Cette évolution montre un passage des systèmes basés sur des règles explicites à des systèmes capables d’apprendre de manière autonome à partir de données, ce qui a permis à l’IA de s’attaquer à des problèmes de plus en plus complexes.

1.2. Types de Modèles d’IA (Apprentissage Supervisé, Non Supervisé, par Renforcement)

L’apprentissage automatique, sous-domaine clé de l’IA, se divise en plusieurs paradigmes principaux, chacun adapté à différents types de problèmes et de données.

1.2.1. Apprentissage Supervisé (Classification, Régression)

L’apprentissage supervisé est le type d’apprentissage automatique le plus courant. Il s’agit d’apprendre une fonction qui mappe une entrée à une sortie basée sur des paires d’exemples d’entrée-sortie étiquetées. Le modèle apprend à prédire la sortie correcte pour de nouvelles entrées.

•Classification : Prédire une catégorie ou une classe discrète.

•Exemple : Détecter si un e-mail est un spam (oui/non), identifier si une image contient un chat ou un chien, ou classer un commentaire client comme positif, négatif ou neutre. Le modèle est entraîné avec des e-mails déjà étiquetés comme spam ou non-spam.

•Régression : Prédire une valeur continue.

•Exemple : Prédire le prix d’une maison en fonction de sa taille, de son emplacement et du nombre de chambres, ou prévoir la température de demain. Le modèle est entraîné avec des données historiques de maisons et leurs prix réels.

1.2.2. Apprentissage Non Supervisé (Clustering, Réduction de Dimension)

Contrairement à l’apprentissage supervisé, l’apprentissage non supervisé travaille avec des données non étiquetées. L’objectif est de trouver des structures cachées, des motifs ou des relations dans les données.

•Clustering (Regroupement) : Organiser des données en groupes (clusters) de sorte que les éléments de chaque groupe soient plus similaires entre eux qu’avec ceux des autres groupes.

•Exemple : Segmenter des clients en différents groupes basés sur leurs comportements d’achat pour des campagnes marketing ciblées, ou regrouper des articles de presse par sujet sans connaître les sujets à l’avance.

•Réduction de Dimension : Réduire le nombre de variables (caractéristiques) dans un ensemble de données tout en conservant autant d’informations que possible. Cela aide à visualiser les données et à améliorer les performances des algorithmes.

•Exemple : Réduire un ensemble de données de milliers de caractéristiques génétiques à quelques dimensions clés pour identifier des motifs liés à des maladies, ou simplifier des données d’images pour accélérer le traitement.

1.2.3. Apprentissage par Renforcement (Agents, Récompenses, Environnements)

L’apprentissage par renforcement est un paradigme où un agent apprend à prendre des décisions en interagissant avec un environnement. L’agent reçoit des « récompenses » ou des « pénalités » en fonction de ses actions et apprend à maximiser la récompense cumulée au fil du temps.

•Agent : L’entité qui apprend et prend des décisions.

•Environnement : Le monde avec lequel l’agent interagit.

•Récompense : Le feedback que l’agent reçoit de l’environnement.

•Exemple : Un agent d’IA apprenant à jouer aux échecs. Il reçoit une récompense positive s’il gagne la partie et une récompense négative s’il perd. Il apprend par essais et erreurs quelles séquences de mouvements mènent à la victoire. Un robot apprenant à marcher recevrait une récompense pour chaque pas réussi et une pénalité s’il tombe.

1.3. Concepts Clés (Données, Algorithmes, Entraînement, Évaluation)

Indépendamment du type d’apprentissage, plusieurs concepts fondamentaux sont omniprésents dans le développement et le déploiement des modèles d’IA.

1.3.1. Importance des Données (Qualité, Quantité, Préparation)

Les données sont le carburant de l’IA. Sans données de qualité et en quantité suffisante, même les algorithmes les plus sophistiqués ne peuvent pas apprendre efficacement.

•Quantité : Les modèles d’apprentissage profond, en particulier, nécessitent de très grandes quantités de données pour atteindre des performances élevées.

•Qualité : Les données doivent être précises, pertinentes, complètes et exemptes de bruit ou d’erreurs. Des données de mauvaise qualité peuvent entraîner des modèles biaisés ou peu performants (« Garbage In, Garbage Out »).

•Préparation (Nettoyage, Normalisation, Étiquetage) : Les données brutes nécessitent souvent un nettoyage (gestion des valeurs manquantes, suppression des doublons), une normalisation (mise à l’échelle des valeurs) et, pour l’apprentissage supervisé, un étiquetage précis (associer chaque entrée à sa sortie correcte).

•Exemple : Pour un modèle de reconnaissance vocale, il faut des milliers d’heures d’enregistrements audio transcrits avec précision. Si les transcriptions sont erronées ou si l’audio est de mauvaise qualité, le modèle ne pourra pas apprendre à reconnaître la parole correctement.

1.3.2. Rôle des Algorithmes et des Modèles Mathématiques

Les algorithmes sont les recettes qui permettent aux modèles d’apprendre à partir des données. Ils définissent la structure et la logique par lesquelles le modèle va traiter les informations.

•Algorithmes : Ce sont des ensembles d’instructions pas à pas que l’ordinateur suit pour résoudre un problème ou effectuer une tâche. En IA, les algorithmes sont utilisés pour construire et entraîner les modèles.

•Modèles Mathématiques : Les algorithmes d’IA sont basés sur des principes mathématiques et statistiques complexes (algèbre linéaire, calcul différentiel, probabilités). Ces modèles définissent la relation entre les entrées et les sorties, et la manière dont le modèle ajuste ses paramètres pendant l’entraînement.

•Exemple : Un algorithme de régression linéaire utilise une équation mathématique simple (y = ax + b) pour trouver la meilleure ligne qui décrit la relation entre deux variables. Un réseau de neurones utilise des fonctions mathématiques non linéaires pour transformer les données à travers plusieurs couches.

1.3.3. Processus d’Entraînement et d’Optimisation

L’entraînement est le processus par lequel un modèle d’IA apprend à partir des données. L’optimisation est le mécanisme qui permet au modèle d’améliorer ses performances pendant l’entraînement.

•Entraînement : Le modèle est exposé à un grand ensemble de données (données d’entraînement) et ajuste ses paramètres internes (poids, biais) pour minimiser l’erreur entre ses prédictions et les sorties réelles.

•Fonction de Perte (Loss Function) : Mesure l’erreur du modèle. L’objectif de l’entraînement est de minimiser cette fonction.

•Optimiseur : Un algorithme (par exemple, la descente de gradient) qui ajuste les paramètres du modèle pour réduire la fonction de perte.

•Exemple : Lors de l’entraînement d’un modèle de reconnaissance d’images, le modèle fait une prédiction (par exemple, « c’est un chat »). Si la vraie étiquette est « chien », la fonction de perte calcule l’erreur. L’optimiseur utilise cette erreur pour ajuster les poids du réseau de neurones afin que la prochaine fois, il soit plus susceptible de prédire « chien » pour une image similaire.

1.3.4. Métriques d’Évaluation et Validation des Modèles

Une fois entraîné, un modèle doit être évalué pour s’assurer qu’il généralise bien à de nouvelles données non vues et qu’il répond aux objectifs fixés.

•Données de Validation et de Test : Les données sont généralement divisées en ensembles d’entraînement, de validation (pour l’ajustement des hyperparamètres) et de test (pour l’évaluation finale).

•Métriques d’Évaluation : Des mesures quantitatives sont utilisées pour évaluer la performance du modèle. Le choix de la métrique dépend du type de problème :

•Classification : Précision (Accuracy), Rappel (Recall), F1-score, AUC-ROC.

•Régression : Erreur Quadratique Moyenne (MSE), Erreur Absolue Moyenne (MAE), R-carré.

•Validation Croisée : Une technique pour évaluer la performance du modèle de manière plus robuste en divisant les données en plusieurs sous-ensembles et en entraînant/testant le modèle plusieurs fois.

•Exemple : Pour un modèle de détection de fraude, la précision peut ne pas être suffisante si la fraude est rare. Le rappel (capacité à détecter toutes les fraudes) et le F1-score (équilibre entre précision et rappel) seraient des métriques plus appropriées pour s’assurer que le modèle ne manque pas de cas de fraude importants, même s’il fait quelques fausses alertes.

Ces concepts forment la base de la compréhension des modèles d’IA et sont essentiels pour quiconque souhaite s’engager dans ce domaine.

2. Modèles d’IA Fondamentaux

Après avoir exploré les concepts fondamentaux de l’intelligence artificielle, il est essentiel de se pencher sur les modèles d’IA spécifiques qui constituent le cœur de cette discipline. Cette section détaillera les principales catégories de modèles, de l’apprentissage profond aux approches statistiques et basées sur la logique, en soulignant leurs architectures et leurs applications.

2.1. Réseaux de Neurones et Apprentissage Profond

Les réseaux de neurones artificiels, et plus particulièrement l’apprentissage profond (Deep Learning), ont révolutionné l’IA au cours de la dernière décennie. Inspirés par la structure du cerveau humain, ces modèles sont capables d’apprendre des représentations complexes à partir de vastes quantités de données.

2.1.1. Architectures Courantes (CNN, RNN, Transformers)

L’apprentissage profond utilise diverses architectures de réseaux de neurones, chacune étant optimisée pour des types de données et des tâches spécifiques.

2.1.1.1. Réseaux de Neurones Convolutifs (CNN) pour la Vision

Les CNN sont particulièrement efficaces pour le traitement des données visuelles, telles que les images et les vidéos. Leur conception est inspirée par le cortex visuel des animaux.

•Fonctionnement : Les CNN utilisent des couches de convolution qui appliquent des filtres pour détecter des motifs locaux (bords, textures, formes) dans les images. Ces motifs sont ensuite combinés dans des couches successives pour former des représentations de plus en plus abstraites et complexes.

•Exemple : Dans un système de reconnaissance faciale, les premières couches d’un CNN pourraient détecter des bords et des coins, les couches intermédiaires des yeux, des nez et des bouches, et les couches finales des visages complets. Ce processus hiérarchique permet au réseau de reconnaître des objets indépendamment de leur position ou de légères variations.

2.1.1.2. Réseaux de Neurones Récurrents (RNN) pour les Séquences

Les RNN sont conçus pour traiter des données séquentielles, où l’ordre des éléments est important, comme le texte, la parole ou les séries temporelles. Ils possèdent une « mémoire » qui leur permet de conserver des informations sur les éléments précédents de la séquence.

•Fonctionnement : Contrairement aux réseaux de neurones classiques, les RNN ont des connexions qui forment des boucles, permettant aux informations de persister d’une étape à l’autre. Cela leur permet de comprendre le contexte et les dépendances à long terme dans les séquences.

•Exemple : Pour la traduction automatique, un RNN peut traiter une phrase mot par mot, en utilisant la compréhension des mots précédents pour interpréter le mot actuel et générer la traduction. Des variantes comme les LSTM (Long Short-Term Memory) et les GRU (Gated Recurrent Unit) ont été développées pour mieux gérer les dépendances à long terme.

2.1.1.3. Transformers pour le Traitement du Langage Naturel

Les Transformers sont une architecture plus récente qui a révolutionné le Traitement du Langage Naturel (TLN). Ils ont supplanté les RNN dans de nombreuses tâches grâce à leur capacité à traiter les séquences en parallèle et à capturer des dépendances à très longue portée.

•Fonctionnement : Les Transformers s’appuient sur un mécanisme d' »attention » qui permet au modèle de pondérer l’importance de différentes parties de la séquence d’entrée lors du traitement de chaque élément. Cela signifie qu’il peut se concentrer sur les mots les plus pertinents, quelle que soit leur position dans la phrase.

•Exemple : Dans un modèle de résumé de texte, un Transformer peut identifier les phrases clés du document source qui sont les plus importantes pour générer un résumé concis et précis, même si ces phrases sont éloignées les unes des autres dans le texte original. Des modèles comme BERT (Bidirectional Encoder Representations from Transformers) et GPT (Generative Pre-trained Transformer) sont basés sur cette architecture.

2.1.2. Applications (Vision par Ordinateur, Traitement du Langage Naturel)

Les réseaux de neurones profonds ont permis des avancées majeures dans de nombreux domaines d’application.

2.1.2.1. Reconnaissance d’Images et Détection d’Objets

La vision par ordinateur, grâce aux CNN, a atteint des niveaux de performance impressionnants.

•Reconnaissance d’Images : Classifier une image entière dans une catégorie spécifique.

•Exemple : Identifier si une image contient un chien, un chat, une voiture, etc. Utilisé dans la recherche d’images, le tri de photos, et les systèmes de sécurité.

•Détection d’Objets : Localiser et identifier plusieurs objets dans une image, en dessinant des boîtes englobantes autour d’eux.

•Exemple : Dans les véhicules autonomes, la détection d’objets permet d’identifier les piétons, les autres véhicules, les panneaux de signalisation et les feux de circulation en temps réel. Dans la surveillance, elle peut détecter des comportements suspects ou des objets abandonnés.

2.1.2.2. Traduction Automatique et Génération de Texte

Le TLN, en particulier avec les Transformers, a transformé la façon dont les machines interagissent avec le langage humain.

•Traduction Automatique : Traduire du texte ou de la parole d’une langue à une autre de manière fluide et contextuellement appropriée.

•Exemple : Google Translate utilise des modèles basés sur des Transformers pour fournir des traductions de haute qualité entre des centaines de langues, en capturant les nuances sémantiques et grammaticales.

•Génération de Texte : Créer du texte cohérent et pertinent à partir d’une invite ou d’un contexte donné.

•Exemple : Les grands modèles de langage (LLM) comme GPT-3 ou GPT-4 peuvent générer des articles de blog, des poèmes, du code informatique, des scripts, et même des conversations interactives, en s’adaptant au style et au ton demandés.

2.2. Modèles Statistiques et Probabilistes

Avant l’avènement de l’apprentissage profond, et encore aujourd’hui pour de nombreux problèmes, les modèles statistiques et probabilistes ont constitué le fondement de l’IA et de l’apprentissage automatique. Ils offrent une approche plus interprétable et sont souvent plus efficaces pour des ensembles de données plus petits ou des problèmes bien définis.

2.2.1. Régression, Classification, Clustering

Ces techniques sont des piliers de l’apprentissage automatique, utilisées pour prédire des valeurs, classer des données ou regrouper des observations similaires.

2.2.1.1. Régression Linéaire et Logistique

•Régression Linéaire : Utilisée pour modéliser la relation linéaire entre une variable dépendante continue et une ou plusieurs variables indépendantes.

•Exemple : Prédire le prix d’une maison en fonction de sa superficie. Le modèle trouve la ligne droite qui minimise la distance entre les points de données et cette ligne.

•Régression Logistique : Bien que son nom contienne « régression », c’est un modèle de classification utilisé pour prédire la probabilité qu’une observation appartienne à une catégorie discrète (souvent binaire).

•Exemple : Prédire si un client va cliquer sur une publicité (oui/non) ou si un e-mail est un spam. Le modèle estime une probabilité, qui est ensuite convertie en une classe.

2.2.1.2. Machines à Vecteurs de Support (SVM)

Les SVM sont des modèles puissants pour la classification et la régression, particulièrement efficaces dans les espaces de grande dimension.

•Fonctionnement : Pour la classification, un SVM trouve l’hyperplan (une ligne en 2D, un plan en 3D, etc.) qui sépare le mieux les différentes classes de données, en maximisant la marge entre l’hyperplan et les points de données les plus proches (les « vecteurs de support »).

•Exemple : Classer des documents textuels en différentes catégories (sport, politique, économie) en trouvant l’hyperplan qui sépare le mieux les caractéristiques des mots dans l’espace de grande dimension.

2.2.1.3. K-Means et DBSCAN

Ces algorithmes sont des méthodes de clustering non supervisé.

•K-Means : Regroupe les données en un nombre prédéfini (K) de clusters. Chaque point de données est assigné au cluster dont le centroïde (moyenne des points) est le plus proche.

•Exemple : Segmenter des clients en 3 groupes (K=3) en fonction de leurs habitudes d’achat pour adapter les stratégies marketing à chaque segment.

•DBSCAN (Density-Based Spatial Clustering of Applications with Noise) : Regroupe les points de données qui sont densément regroupés, marquant comme « bruit » les points qui se trouvent dans des régions de faible densité. Il n’exige pas de spécifier le nombre de clusters à l’avance.

•Exemple : Détecter des zones de forte concentration de fraudes sur une carte géographique, en identifiant les regroupements denses de transactions frauduleuses.

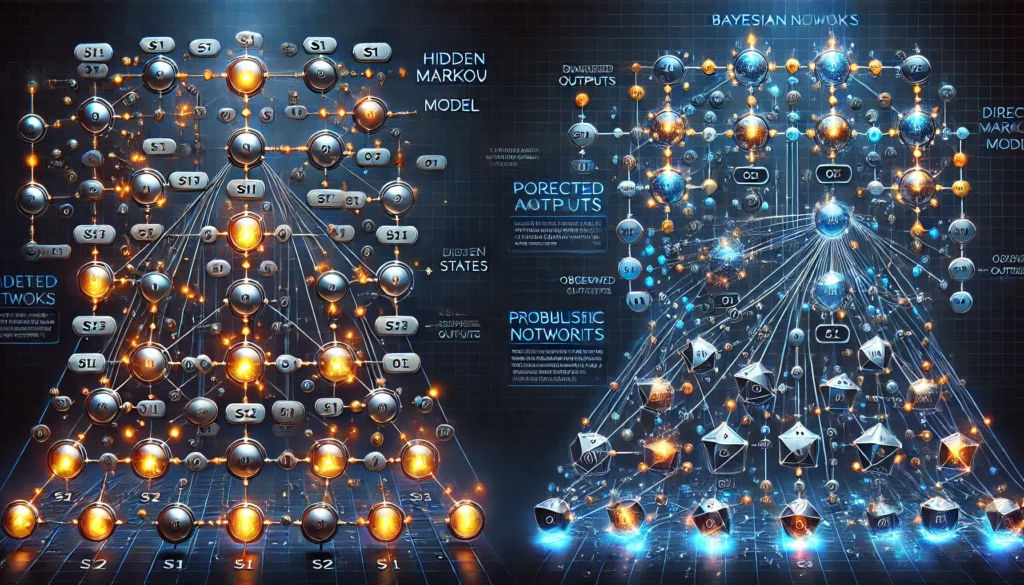

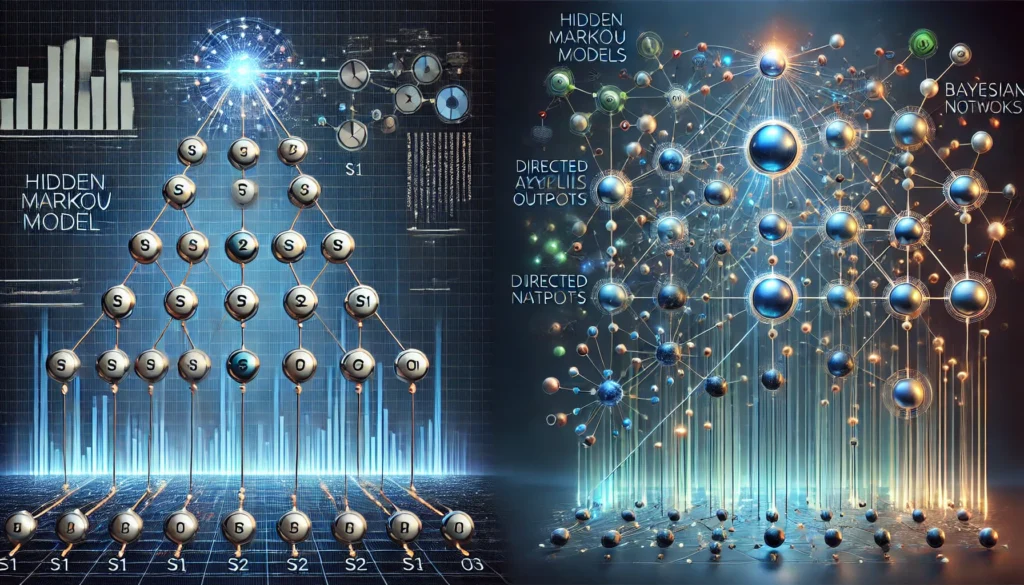

2.2.2. Modèles de Markov Cachés, Réseaux Bayésiens

Ces modèles probabilistes sont utilisés pour modéliser des systèmes où l’incertitude est présente et où les relations entre les variables sont de nature probabiliste.

2.2.2.1. Modèles de Markov Cachés (HMM) pour les Séquences Temporelles

Les HMM sont des modèles statistiques utilisés pour modéliser des séquences d’observations où l’état sous-jacent du système n’est pas directement observable (il est « caché »).

•Fonctionnement : Un HMM est caractérisé par un ensemble d’états cachés, des probabilités de transition entre ces états, et des probabilités d’émission (probabilité d’observer un certain événement à partir d’un état caché donné).

•Exemple : Dans la reconnaissance vocale, les états cachés pourraient représenter les phonèmes (sons de la parole) et les observations les signaux audio. Le HMM permet de déterminer la séquence de phonèmes la plus probable étant donné une séquence de signaux audio, même si les phonèmes ne sont pas directement mesurables.

2.2.2.2. Réseaux Bayésiens pour la Modélisation d’Incertitudes

Les réseaux bayésiens sont des modèles graphiques probabilistes qui représentent un ensemble de variables et leurs dépendances conditionnelles à l’aide d’un graphe acyclique dirigé.

•Fonctionnement : Chaque nœud du graphe représente une variable (par exemple, un symptôme, une maladie) et les arêtes représentent les dépendances probabilistes entre elles. Ils permettent de calculer la probabilité d’un événement étant donné d’autres événements.

•Exemple : Dans un système de diagnostic médical, un réseau bayésien peut modéliser les relations entre les symptômes, les maladies et les résultats de tests. Si un patient présente certains symptômes, le réseau peut calculer la probabilité qu’il ait une maladie spécifique, en tenant compte de l’incertitude des observations.

2.3. Modèles Basés sur les Règles et la Logique

Ces modèles représentent une approche plus symbolique de l’IA, où la connaissance est encodée sous forme de règles logiques et de faits. Ils sont souvent plus interprétables que les modèles statistiques ou neuronaux, mais peuvent être moins flexibles face à des données bruitées ou incomplètes.

2.3.1. Systèmes Experts, Logique Floue

Ces approches permettent de capturer et d’utiliser l’expertise humaine dans des systèmes informatiques.

2.3.1.1. Systèmes Experts et Bases de Connaissances

Les systèmes experts sont des programmes informatiques qui imitent la capacité de prise de décision d’un expert humain dans un domaine spécifique. Ils sont basés sur une « base de connaissances » contenant des faits et des règles.

•Fonctionnement : Un système expert se compose d’une base de connaissances (règles « SI-ALORS » et faits), d’un moteur d’inférence (qui applique les règles pour déduire de nouvelles informations) et d’une interface utilisateur.

•Exemple : MYCIN, un système expert des années 1970, était conçu pour diagnostiquer des infections sanguines et recommander des traitements. Il utilisait des règles comme « SI le patient a de la fièvre ET les cultures montrent des bactéries Gram-négatives ALORS il est probable que le patient ait une infection bactérienne ».

2.3.1.2. Logique Floue pour la Gestion de l’Imprécision

La logique floue est une extension de la logique booléenne qui permet de gérer l’incertitude et l’imprécision, en attribuant des degrés d’appartenance à des ensembles plutôt que des valeurs binaires (vrai/faux).

•Fonctionnement : Au lieu de dire qu’une température est « chaude » ou « non chaude », la logique floue permet de dire qu’elle est « plutôt chaude » ou « légèrement chaude » avec un certain degré d’appartenance. Elle utilise des fonctions d’appartenance pour mapper les valeurs d’entrée à des degrés de vérité.

•Exemple : Dans un système de contrôle de climatisation, la logique floue peut gérer des concepts comme « température confortable » ou « ventilation modérée », permettant un contrôle plus nuancé et humain-like que les systèmes basés sur des seuils rigides. Elle est souvent utilisée dans les systèmes de contrôle industriels et les appareils électroménagers.

2.3.2. Programmation Logique

La programmation logique est un paradigme de programmation basé sur la logique formelle. Les programmes sont exprimés sous forme de faits et de règles logiques, et l’exécution du programme consiste à prouver des théorèmes.

2.3.2.1. Prolog et Raisonnement Déductif

Prolog (PROgrammation en LOGique) est le langage de programmation logique le plus connu.

•Fonctionnement : En Prolog, on déclare des faits (par exemple, parent(jean, marie).) et des règles (par exemple, grand_parent(X, Z) :- parent(X, Y), parent(Y, Z).). Le système peut ensuite répondre à des requêtes en utilisant le raisonnement déductif pour trouver toutes les solutions possibles.

•Exemple : Si on demande grand_parent(X, marie)., Prolog va chercher tous les X pour lesquels la règle grand_parent est vraie par rapport à Marie. Il est utilisé dans des domaines comme les bases de données déductives, le traitement du langage naturel et la planification en IA.

3. Agents d’IA : Conception et Fonctionnement

Les agents d’Intelligence Artificielle représentent une composante essentielle de nombreux systèmes intelligents modernes. Un agent est une entité capable de percevoir son environnement à travers des capteurs et d’agir sur cet environnement à travers des effecteurs. L’étude des agents d’IA vise à comprendre comment concevoir des programmes qui peuvent opérer de manière autonome et intelligente pour atteindre des objectifs donnés.

3.1. Définition et Caractéristiques d’un Agent d’IA

Un agent d’IA peut être défini comme tout ce qui peut être considéré comme percevant son environnement par le biais de capteurs et agissant sur cet environnement par le biais d’effecteurs. Cette définition est large et englobe une grande variété de systèmes, des simples thermostats aux robots autonomes complexes.

3.1.1. Agent Rationnel vs. Agent Intelligent

Il est crucial de distinguer un agent simplement « intelligent » d’un agent « rationnel » dans le contexte de l’IA :

•Agent Intelligent : Un agent intelligent est capable de percevoir son environnement et d’agir en conséquence. Il peut apprendre et s’adapter à de nouvelles situations. Cependant, ses actions ne sont pas nécessairement optimales ou basées sur une logique rigoureuse.

•Exemple : Un thermostat qui s’allume ou s’éteint en fonction d’une température seuil est un agent intelligent simple. Il perçoit la température et agit sur le chauffage, mais il ne cherche pas à optimiser la consommation d’énergie ou à anticiper les changements de température.

•Agent Rationnel : Un agent rationnel est un agent qui agit de manière à maximiser sa mesure de performance, compte tenu des informations disponibles. La rationalité est liée à la capacité de l’agent à prendre la meilleure décision possible dans un contexte donné pour atteindre ses objectifs. Cela implique souvent une planification, un raisonnement et une capacité à gérer l’incertitude.

•Exemple : Un véhicule autonome est un agent rationnel. Il perçoit son environnement (autres voitures, piétons, feux de signalisation) via des capteurs (caméras, lidar, radar) et agit (accélérer, freiner, tourner) pour atteindre sa destination en toute sécurité et efficacement, en minimisant les risques et en respectant le code de la route. Ses décisions sont basées sur une analyse complexe des données perçues et une planification des actions optimales.

La rationalité est un concept clé en IA, car elle fournit un cadre pour la conception d’agents qui se comportent de manière optimale dans des environnements complexes et incertains.

3.1.2. Propriétés des Agents (Autonomie, Réactivité, Proactivité, Socialité)

Les agents d’IA peuvent posséder diverses propriétés qui définissent leur comportement et leurs capacités. Les quatre propriétés principales sont :

•Autonomie : Un agent autonome est capable d’opérer sans intervention humaine constante. Il peut prendre ses propres décisions et initier des actions basées sur ses perceptions et ses objectifs internes.

•Exemple : Un robot aspirateur est autonome. Une fois programmé, il navigue dans la maison, détecte les obstacles et nettoie sans supervision directe.

•Réactivité : Un agent réactif est capable de répondre en temps opportun aux changements dans son environnement. Il perçoit les stimuli et réagit immédiatement en fonction de règles ou de comportements préprogrammés.

•Exemple : Un système de détection d’incendie est réactif. Dès qu’il détecte de la fumée ou une augmentation rapide de la température, il déclenche une alarme.

•Proactivité : Un agent proactif ne se contente pas de réagir aux événements, il prend l’initiative et agit pour atteindre ses objectifs, même en l’absence de stimuli externes. Il anticipe les situations et planifie ses actions.

•Exemple : Un agent de planification de voyage proactif pourrait non seulement trouver des vols et des hôtels en fonction des préférences de l’utilisateur, mais aussi suggérer des activités, des restaurants ou des itinéraires touristiques en fonction des prévisions météorologiques ou des événements locaux.

•Socialité : Un agent social est capable d’interagir avec d’autres agents (humains ou artificiels) pour atteindre ses objectifs. Cela implique des capacités de communication, de coordination et de négociation.

•Exemple : Des agents logiciels dans un système de gestion de la chaîne d’approvisionnement qui communiquent entre eux pour optimiser les stocks, les commandes et les livraisons, ou des agents conversationnels qui interagissent avec les utilisateurs pour résoudre des problèmes ou fournir des informations.

3.2. Types d’Agents (Réflexes Simples, Basés sur un Modèle, Basés sur un But, Basés sur l’Utilité)

Les agents d’IA peuvent être classifiés en fonction de leur niveau de sophistication et de la manière dont ils prennent leurs décisions. Cette classification permet de comprendre la complexité croissante des systèmes d’IA.

3.2.1. Agents Réflexes Simples (Condition-Action)

Les agents réflexes simples sont les plus rudimentaires. Ils agissent en fonction de la perception actuelle de l’environnement, sans tenir compte de l’historique des perceptions ou de l’état passé. Leur comportement est dicté par un ensemble de règles « condition-action » directes.

•Fonctionnement : Si une certaine condition est remplie dans l’environnement, l’agent exécute une action prédéfinie. Il n’a pas de mémoire de ses actions passées ni de ses perceptions antérieures.

•Exemple : Un thermostat simple qui s’allume si la température est inférieure à un seuil et s’éteint si elle est supérieure. Un système d’alarme incendie qui déclenche l’alarme dès qu’il détecte de la fumée. Ces agents sont rapides et efficaces pour des environnements simples et des tâches bien définies, mais ils sont incapables de s’adapter à des situations nouvelles ou complexes.

3.2.2. Agents Basés sur un Modèle (État Interne)

Les agents basés sur un modèle maintiennent un « état interne » qui représente leur compréhension du monde. Cet état interne est mis à jour en fonction des perceptions actuelles et des actions passées. Cela leur permet de prendre des décisions basées sur une compréhension plus complète de l’environnement, même si certaines informations ne sont pas directement observables.

•Fonctionnement : L’agent construit un modèle du monde qui décrit comment l’environnement évolue indépendamment de l’agent et comment les actions de l’agent affectent l’environnement. Il utilise ce modèle pour prédire les conséquences de ses actions.

•Exemple : Un système de navigation GPS qui utilise un modèle de la carte routière (état interne) pour déterminer le meilleur itinéraire. Il perçoit la position actuelle du véhicule et met à jour son modèle pour anticiper les virages et les intersections. Un robot qui navigue dans une pièce inconnue en construisant une carte interne de son environnement à partir de ses capteurs.

3.2.3. Agents Basés sur un But (Objectifs)

Les agents basés sur un but sont plus sophistiqués que les agents basés sur un modèle. En plus de maintenir un état interne du monde, ils ont des « buts » ou des objectifs à atteindre. Leurs actions sont choisies pour minimiser la distance entre l’état actuel et l’état désiré (le but).

•Fonctionnement : Ces agents utilisent la planification pour trouver une séquence d’actions qui les mènera à leur but. Ils peuvent explorer différentes options et choisir celle qui est la plus efficace ou la plus sûre.

•Exemple : Un agent de jeu d’échecs qui a pour but de mettre le roi adverse en échec et mat. Il ne se contente pas de réagir aux mouvements de l’adversaire, mais planifie plusieurs coups à l’avance pour atteindre son objectif. Un système de gestion de production qui a pour but de maximiser la production tout en minimisant les coûts, en planifiant l’ordonnancement des tâches et l’allocation des ressources.

3.2.4. Agents Basés sur l’Utilité (Optimisation)

Les agents basés sur l’utilité sont les plus avancés. En plus d’avoir des buts, ils ont une « fonction d’utilité » qui leur permet de mesurer la désirabilité de chaque état du monde et de chaque séquence d’actions. Cela leur permet de prendre des décisions optimales même lorsque les buts sont multiples, conflictuels ou incertains.

•Fonctionnement : L’agent calcule l’utilité attendue de chaque action possible et choisit celle qui maximise cette utilité. Cela implique souvent de prendre en compte les probabilités des différents résultats et les coûts associés.

•Exemple : Un agent de trading boursier qui a pour but de maximiser les profits tout en minimisant les risques. Il ne se contente pas d’atteindre un objectif de profit, mais évalue la probabilité de succès de chaque transaction et le risque de perte associé, afin de prendre la décision la plus avantageuse. Un véhicule autonome qui, en plus d’atteindre sa destination, doit optimiser le confort des passagers, la consommation de carburant et la sécurité, en pondérant ces différents facteurs pour chaque décision de conduite.

3.3. Architectures d’Agents (Perception, Action, Apprentissage)

L’architecture d’un agent d’IA décrit la manière dont ses composants internes sont organisés et interagissent pour permettre à l’agent de percevoir, de raisonner et d’agir. Comprendre ces architectures est essentiel pour concevoir des agents efficaces et robustes.

3.3.1. Capteurs et Effecteurs

Les capteurs et les effecteurs sont les interfaces de l’agent avec son environnement. Ils sont fondamentaux pour toute interaction et pour la capacité de l’agent à opérer dans le monde réel.

•Capteurs (Sensors) : Ce sont les dispositifs ou les mécanismes qui permettent à l’agent de percevoir son environnement. Ils convertissent les informations du monde réel en un format que l’agent peut traiter.

•Exemple : Pour un véhicule autonome, les capteurs incluent les caméras (pour la vision), les lidars (pour la détection de distance et la cartographie 3D), les radars (pour la détection d’objets et la mesure de vitesse), les capteurs à ultrasons (pour les courtes distances), et le GPS (pour la localisation). Pour un chatbot, les capteurs sont les entrées textuelles ou vocales de l’utilisateur.

•Effecteurs (Actuators) : Ce sont les dispositifs ou les mécanismes qui permettent à l’agent d’agir sur son environnement. Ils convertissent les décisions de l’agent en actions physiques ou logiques.

•Exemple : Pour un véhicule autonome, les effecteurs sont le volant (pour la direction), l’accélérateur et le frein (pour la vitesse), et les feux de signalisation. Pour un chatbot, les effecteurs sont la génération de réponses textuelles ou vocales, ou l’exécution de commandes (par exemple, envoyer un e-mail, jouer une chanson).

3.3.2. Composants d’Apprentissage et de Planification

Au-delà de la simple perception et action, les agents sophistiqués intègrent des composants internes pour l’apprentissage et la planification, leur permettant d’améliorer leurs performances et d’atteindre des objectifs complexes.

•Composant d’Apprentissage (Learning Component) : Ce module est responsable de l’amélioration des performances de l’agent au fil du temps. Il analyse les données de performance (les succès et les échecs de l’agent) et ajuste les paramètres internes de l’agent pour optimiser ses actions futures. C’est ici que les modèles d’apprentissage automatique (supervisé, non supervisé, par renforcement) sont intégrés.

•Exemple : Dans un système de recommandation de films, le composant d’apprentissage analyse les films que l’utilisateur a aimés ou non, et ajuste son modèle interne pour proposer des recommandations plus pertinentes à l’avenir. Pour un robot qui apprend à marcher, le composant d’apprentissage utilise les retours du monde réel (par exemple, s’il tombe ou non) pour affiner ses mouvements.

•Composant de Planification (Planning Component) : Ce module est chargé de déterminer la séquence d’actions à entreprendre pour atteindre un objectif donné. Il utilise un modèle du monde (souvent appris par le composant d’apprentissage) pour simuler les conséquences des différentes actions et choisir le plan optimal.

•Exemple : Un agent de logistique qui doit livrer des colis à plusieurs destinations. Le composant de planification détermine l’itinéraire le plus efficace en tenant compte du trafic, des délais de livraison et des capacités du véhicule. Pour un agent de jeu vidéo, le composant de planification élabore des stratégies pour battre l’adversaire en anticipant ses mouvements.

Ces composants travaillent souvent en synergie. Le composant d’apprentissage peut améliorer le modèle du monde utilisé par le composant de planification, et les résultats de la planification peuvent fournir de nouvelles données pour l’apprentissage. Cette boucle de rétroaction permet aux agents d’IA de devenir de plus en plus autonomes et performants dans des environnements dynamiques et incertains.

4. Interaction entre Modèles et Agents d’IA

L’efficacité et la sophistication des agents d’IA modernes reposent intrinsèquement sur leur capacité à intégrer et à exploiter divers modèles d’intelligence artificielle. Les modèles d’IA ne sont pas des entités isolées ; ils servent de cerveaux, de systèmes de perception, de moteurs de décision et de mécanismes d’apprentissage pour les agents. Cette section explore la symbiose entre les modèles d’IA et les agents, démontrant comment les premiers alimentent les capacités des seconds pour interagir intelligemment avec le monde.

4.1. Comment les Modèles d’IA Alimentent les Agents

Les agents d’IA, qu’ils soient logiciels ou physiques, ont besoin de comprendre leur environnement et de prendre des décisions éclairées. C’est là que les modèles d’IA entrent en jeu, en fournissant les capacités cognitives nécessaires à la perception et à la planification.

4.1.1. Modèles de Perception (Vision, Langage)

Pour qu’un agent puisse interagir avec son environnement, il doit d’abord être capable de le percevoir. Les modèles de perception sont les yeux et les oreilles de l’agent, transformant les données brutes des capteurs en informations structurées et significatives.

•Vision par Ordinateur : Les modèles de vision par ordinateur, souvent basés sur des Réseaux de Neurones Convolutifs (CNN), permettent aux agents de « voir » et d’interpréter des images et des vidéos. Ils peuvent identifier des objets, reconnaître des visages, détecter des mouvements, et comprendre des scènes complexes.

•Exemple : Un agent de surveillance autonome dans un entrepôt utilise des modèles de vision pour détecter les anomalies (par exemple, des objets tombés, des personnes non autorisées), identifier les palettes et les chariots élévateurs, et naviguer en évitant les obstacles. Les CNN lui permettent de classer les objets perçus et de comprendre leur position relative dans l’espace.

•Traitement du Langage Naturel (TLN) : Les modèles de TLN, notamment ceux basés sur les architectures Transformer (comme BERT ou GPT), confèrent aux agents la capacité de comprendre et de générer le langage humain. Cela inclut la compréhension du sens des phrases, la reconnaissance de l’intention de l’utilisateur, la traduction, et la génération de réponses cohérentes.

•Exemple : Un agent conversationnel (chatbot) intégré à un service client utilise des modèles de TLN pour analyser les requêtes des utilisateurs, comprendre leurs besoins (par exemple, « Je veux changer mon mot de passe », « Quel est le statut de ma commande ? »), et générer des réponses appropriées. Ces modèles lui permettent de décomposer la phrase, d’extraire les entités clés et de formuler une réponse naturelle.

Ces modèles de perception sont cruciaux car ils transforment le flux continu de données sensorielles en une représentation symbolique ou numérique que les autres composants de l’agent peuvent utiliser pour le raisonnement et la prise de décision.

4.1.2. Modèles de Décision et de Planification

Une fois que l’agent a perçu son environnement, il doit décider de la meilleure action à entreprendre pour atteindre ses objectifs. Les modèles de décision et de planification fournissent les mécanismes de raisonnement qui guident le comportement de l’agent.

•Modèles de Décision : Ces modèles aident l’agent à choisir une action parmi plusieurs alternatives, souvent en évaluant les conséquences potentielles de chaque choix. Ils peuvent être basés sur des règles (systèmes experts), des probabilités (réseaux bayésiens) ou des fonctions d’utilité.

•Exemple : Dans un système de diagnostic médical assisté par IA, un agent utilise des modèles de décision pour évaluer la probabilité de différentes maladies en fonction des symptômes du patient et des résultats des tests. Le modèle de décision peut recommander le test le plus pertinent à effectuer ensuite, ou le traitement le plus probable, en tenant compte des risques et des bénéfices.

•Modèles de Planification : Ces modèles permettent à l’agent de déterminer une séquence d’actions pour atteindre un but spécifique. Ils impliquent souvent la recherche dans un espace d’états pour trouver le chemin optimal, en tenant compte des contraintes et des incertitudes de l’environnement.

•Exemple : Un agent de planification logistique pour une flotte de livraison utilise des modèles de planification pour optimiser les itinéraires de livraison. Le modèle prend en compte les adresses des clients, les fenêtres de livraison, la capacité des véhicules, le trafic en temps réel et les conditions météorologiques pour générer le plan de tournée le plus efficace, minimisant le temps et le carburant.

Ces modèles sont le cerveau de l’agent, lui permettant de passer de la simple perception à l’action intelligente et ciblée. Ils peuvent être statiques (règles prédéfinies) ou dynamiques (apprenant et s’adaptant au fil du temps).

4.2. Exemples d’Agents Utilisant des Modèles Spécifiques (Chatbots, Véhicules Autonomes)

Pour illustrer concrètement l’interaction entre les modèles d’IA et les agents, examinons deux exemples emblématiques : les chatbots et les véhicules autonomes. Ces applications démontrent comment différents modèles d’IA sont intégrés pour créer des agents capables de performances complexes et intelligentes.

4.2.1. Chatbots et Modèles de Traitement du Langage Naturel

Les chatbots sont des agents conversationnels conçus pour interagir avec les humains en utilisant le langage naturel. Leur intelligence repose presque entièrement sur des modèles de Traitement du Langage Naturel (TLN).

•Perception (Compréhension du Langage) : Lorsqu’un utilisateur tape ou prononce une requête, le chatbot utilise des modèles de TLN pour la « percevoir » et la « comprendre ».

•Modèles de Reconnaissance Vocale (ASR) : Si l’entrée est vocale, des modèles ASR (Automatic Speech Recognition), souvent basés sur des réseaux de neurones récurrents (RNN) ou des Transformers, convertissent l’audio en texte. Par exemple, lorsque vous dites « Hey Google, quel temps fait-il ? », un modèle ASR transforme votre voix en texte.

•Modèles de Compréhension du Langage Naturel (NLU) : Une fois le texte obtenu, des modèles NLU, souvent des Transformers pré-entraînés comme BERT ou GPT, analysent la phrase pour en extraire l’intention de l’utilisateur et les entités clés. Par exemple, pour « Quel temps fait-il à Paris demain ? », le modèle NLU identifie l’intention « demander la météo », la localisation « Paris » et la date « demain ».

•Décision et Action (Génération de Réponse) : Après avoir compris la requête, le chatbot doit formuler une réponse pertinente.

•Modèles de Génération de Langage Naturel (NLG) : Des modèles NLG, également souvent basés sur des Transformers (comme GPT-3 ou GPT-4), génèrent la réponse textuelle. Ces modèles sont capables de produire un texte fluide, cohérent et contextuellement approprié. Par exemple, si l’intention est de connaître la météo, le modèle NLG va formuler une phrase comme « La météo à Paris pour demain est ensoleillée avec une température de 25 degrés Celsius. »

•Intégration avec des Bases de Connaissances/APIs : Souvent, le chatbot ne génère pas la réponse de toutes pièces. Il utilise les informations extraites par le NLU pour interroger des bases de données ou des APIs externes (par exemple, une API météo, une base de données de produits) et intègre les résultats dans sa réponse générée par le NLG.

•Apprentissage : Les chatbots les plus avancés intègrent des boucles d’apprentissage par renforcement ou d’apprentissage supervisé pour améliorer leurs performances au fil du temps, en se basant sur les interactions avec les utilisateurs et les retours (par exemple, si une réponse a été utile ou non).

4.2.2. Véhicules Autonomes et Modèles de Vision/Planification

Les véhicules autonomes sont des agents complexes qui opèrent dans un environnement physique dynamique et incertain. Leur fonctionnement repose sur une intégration sophistiquée de multiples modèles d’IA pour la perception, la décision et l’action.

•Perception (Compréhension de l’Environnement) : Le véhicule autonome doit constamment percevoir et interpréter son environnement en temps réel.

•Modèles de Vision par Ordinateur (CNN) : Des CNN sont utilisés pour traiter les données des caméras afin de détecter et de classer les objets (autres véhicules, piétons, cyclistes, panneaux de signalisation, feux de circulation), de reconnaître les voies de circulation et d’estimer les distances. Par exemple, un CNN peut identifier un panneau « Stop » et déterminer sa distance et son orientation.

•Modèles de Fusion de Capteurs : Les données provenant de différents capteurs (caméras, lidar, radar, ultrasons) sont fusionnées par des modèles probabilistes (par exemple, filtres de Kalman étendus ou filtres de particules) pour créer une représentation 3D cohérente et robuste de l’environnement. Cette fusion permet de compenser les limites de chaque capteur et d’améliorer la précision de la perception.

•Décision et Planification (Navigation et Manœuvre) : Une fois l’environnement compris, le véhicule doit décider de la meilleure action à entreprendre.

•Modèles de Prédiction de Comportement : Des modèles prédictifs, souvent basés sur des réseaux de neurones ou des modèles probabilistes, estiment les trajectoires futures des autres usagers de la route (par exemple, où un piéton va marcher, si une voiture va changer de voie). Cela permet au véhicule autonome d’anticiper et de réagir de manière proactive.

•Modèles de Planification de Trajectoire : Des algorithmes de planification (souvent basés sur des techniques de recherche de chemin ou d’optimisation) génèrent des trajectoires sûres et efficaces. Ces modèles prennent en compte les règles de circulation, les obstacles détectés, les prédictions de comportement des autres agents, et les objectifs de navigation (par exemple, atteindre une destination, changer de voie). Par exemple, le modèle peut décider de ralentir et de changer de voie pour éviter un obstacle inattendu.

•Modèles de Contrôle : Des modèles de contrôle (par exemple, PID controllers, ou des contrôleurs basés sur l’apprentissage par renforcement) traduisent la trajectoire planifiée en commandes physiques pour les effecteurs du véhicule (accélérateur, frein, direction).

•Apprentissage : Les véhicules autonomes apprennent continuellement de leurs expériences de conduite, souvent via l’apprentissage par renforcement pour affiner les politiques de conduite dans des situations complexes, ou via l’apprentissage supervisé pour améliorer la précision des modèles de perception et de prédiction.

Ces exemples soulignent la complexité et l’interdépendance des différents modèles d’IA nécessaires pour construire des agents intelligents et autonomes capables d’opérer dans le monde réel. Chaque composant joue un rôle crucial, et leur intégration harmonieuse est la clé de la performance globale de l’agent.

4.3. L’Apprentissage par Renforcement et les Agents

L’apprentissage par renforcement (AR) est un paradigme d’apprentissage automatique particulièrement adapté à la conception d’agents autonomes. Il permet à un agent d’apprendre à prendre des décisions optimales dans un environnement dynamique en interagissant avec celui-ci et en recevant des retours sous forme de récompenses ou de pénalités. C’est la méthode d’apprentissage qui se rapproche le plus de la manière dont les humains et les animaux apprennent par essais et erreurs.

4.3.1. Principes de l’Apprentissage par Renforcement

L’apprentissage par renforcement est centré sur un agent qui interagit avec un environnement. Les éléments clés de ce processus sont :

•Agent : L’entité qui prend des décisions (actions) et cherche à maximiser une récompense cumulée.

•Environnement : Le monde dans lequel l’agent opère. L’environnement réagit aux actions de l’agent en changeant d’état et en fournissant une récompense.

•État (State) : Une description de la situation actuelle de l’environnement perçue par l’agent.

•Action (Action) : Une décision prise par l’agent qui affecte l’environnement.

•Récompense (Reward) : Un signal numérique (positif ou négatif) que l’environnement donne à l’agent après chaque action. L’objectif de l’agent est de maximiser la somme des récompenses au fil du temps.

•Politique (Policy) : La stratégie de l’agent, c’est-à-dire la manière dont il choisit ses actions en fonction de l’état actuel. L’apprentissage par renforcement vise à trouver une politique optimale.

•Fonction de Valeur (Value Function) : Une estimation de la récompense future cumulée qu’un agent peut espérer obtenir à partir d’un certain état ou en exécutant une certaine action dans un certain état. Elle guide l’agent dans ses choix.

Le processus d’apprentissage est itératif : l’agent observe l’état de l’environnement, choisit une action selon sa politique actuelle, exécute l’action, reçoit une récompense et observe le nouvel état. Il utilise ensuite cette expérience pour ajuster sa politique et ses fonctions de valeur, afin de prendre de meilleures décisions à l’avenir. Le défi réside souvent dans le compromis entre l’exploration (essayer de nouvelles actions pour découvrir de meilleures récompenses) et l’exploitation (utiliser les actions connues qui ont déjà rapporté de bonnes récompenses).

4.3.2. Applications (Jeux, Robotique, Optimisation)

L’apprentissage par renforcement a démontré des capacités remarquables dans des domaines où les agents doivent opérer de manière autonome et prendre des décisions séquentielles dans des environnements complexes.

•Jeux : C’est l’un des domaines où l’AR a obtenu les succès les plus médiatisés.

•Exemple : AlphaGo de DeepMind, qui a battu les meilleurs joueurs humains au jeu de Go, a utilisé des techniques d’apprentissage par renforcement profond (Deep Reinforcement Learning) combinées à des réseaux de neurones. L’agent a appris à jouer en s’entraînant contre lui-même des millions de fois, découvrant des stratégies que les humains n’avaient jamais envisagées. Des systèmes similaires ont été développés pour les échecs, le shogi, et même des jeux vidéo complexes comme StarCraft II, où les agents surpassent les performances humaines.

•Robotique : L’AR est idéal pour apprendre aux robots à effectuer des tâches complexes dans le monde physique, où la programmation explicite de chaque mouvement serait trop difficile ou impossible.

•Exemple : Un robot manipulateur peut apprendre à saisir des objets de formes et de tailles variées en recevant des récompenses pour les saisies réussies et des pénalités pour les échecs. L’agent robot apprend par essais et erreurs à affiner sa coordination et sa dextérité. L’AR est également utilisé pour la navigation autonome de robots mobiles, leur permettant d’apprendre à éviter les obstacles et à atteindre des cibles dans des environnements inconnus.

•Optimisation et Gestion de Ressources : L’AR peut être appliqué à des problèmes d’optimisation où des décisions séquentielles doivent être prises pour maximiser une certaine métrique.

•Exemple : L’optimisation de la consommation d’énergie dans les centres de données. Un agent d’AR peut apprendre à ajuster dynamiquement la climatisation, la ventilation et la charge des serveurs en fonction des prévisions de température, des coûts de l’électricité et de la demande de calcul, afin de minimiser la consommation d’énergie tout en maintenant les performances. D’autres applications incluent la gestion du trafic urbain (optimisation des feux de signalisation), la gestion de portefeuille financier, et la conception de systèmes de recommandation personnalisés.

L’apprentissage par renforcement est une approche puissante pour créer des agents capables d’autonomie et d’adaptation, en leur permettant d’apprendre directement de l’expérience dans des environnements complexes et incertains. Sa combinaison avec les réseaux de neurones profonds (Deep Reinforcement Learning) a ouvert la voie à des avancées majeures dans l’IA, permettant aux agents d’atteindre des niveaux de performance surhumains dans de nombreuses tâches.))

5. Défis et Perspectives

L’intelligence artificielle, malgré ses avancées spectaculaires et son potentiel transformateur, est confrontée à des défis significatifs qui doivent être abordés pour assurer son développement responsable et bénéfique. Cette section explore les questions éthiques, la nécessité d’une meilleure interprétabilité des modèles, et les perspectives d’avenir, y compris l’émergence de l’Intelligence Artificielle Générale (AGI).

5.1. Éthique et Responsabilité en IA

Le déploiement croissant de l’IA dans tous les aspects de la société soulève des questions éthiques complexes et impose une réflexion approfondie sur la responsabilité des concepteurs, des développeurs et des utilisateurs de ces systèmes. Les décisions prises par les systèmes d’IA peuvent avoir des conséquences profondes sur les individus et la société, rendant l’éthique un pilier central de son développement.

5.1.1. Biais Algorithmiques et Équité

L’un des défis éthiques les plus pressants est la présence de biais dans les algorithmes d’IA. Ces biais ne sont généralement pas intentionnels, mais résultent de la manière dont les modèles sont entraînés et des données qu’ils consomment.

•Origine des Biais : Les biais peuvent provenir de plusieurs sources :

•Biais dans les Données d’Entraînement : Si les données utilisées pour entraîner un modèle d’IA reflètent des inégalités ou des préjugés existants dans la société, le modèle apprendra et amplifiera ces biais. Par exemple, un système de reconnaissance faciale entraîné principalement sur des visages d’hommes blancs pourrait avoir des performances moindres sur des femmes ou des personnes de couleur.

•Biais de Conception : Les choix faits par les développeurs lors de la conception de l’algorithme ou de la sélection des caractéristiques peuvent introduire des biais. Par exemple, si un modèle de prêt bancaire utilise des critères qui désavantagent implicitement certains groupes socio-économiques.

•Biais de Confirmation : Les systèmes d’IA peuvent renforcer les biais existants en privilégiant les informations qui confirment les schémas appris, même s’ils sont erronés ou discriminatoires.

•Conséquences sur l’Équité : Les biais algorithmiques peuvent entraîner des discriminations et des injustices dans des domaines critiques :

•Justice Pénale : Des systèmes d’IA utilisés pour prédire la récidive peuvent surévaluer le risque pour certaines minorités, conduisant à des peines plus sévères.

•Emploi : Des algorithmes de recrutement peuvent écarter des candidats qualifiés en raison de leur genre, de leur origine ethnique ou de leur âge, si les données d’entraînement reflètent des pratiques de recrutement passées biaisées.

•Crédit et Assurance : Des modèles peuvent refuser des prêts ou augmenter les primes d’assurance pour des groupes spécifiques sans justification objective, mais en se basant sur des corrélations biaisées dans les données.

•Atténuation des Biais : Aborder les biais nécessite une approche multidisciplinaire :

•Audit des Données : Examiner attentivement les données d’entraînement pour identifier et corriger les déséquilibres ou les représentations sous-optimales.

•Algorithmes Équitables : Développer des algorithmes qui intègrent des contraintes d’équité, par exemple en s’assurant que les performances du modèle sont similaires pour différents groupes démographiques.

•Transparence et Explicabilité : Rendre les décisions des modèles plus compréhensibles pour identifier les sources de biais (voir section 5.2).

•Diversité des Équipes : S’assurer que les équipes de développement d’IA sont diverses pour apporter différentes perspectives et réduire les angles morts.

5.1.2. Transparence et Responsabilité

La complexité croissante des modèles d’IA, en particulier des réseaux de neurones profonds, les rend souvent opaques, ce qui soulève des questions de transparence et de responsabilité.

•Le Problème de la « Boîte Noire » : De nombreux modèles d’IA sont considérés comme des « boîtes noires » car il est difficile de comprendre comment ils arrivent à leurs décisions. Cela pose problème lorsque ces systèmes sont utilisés dans des contextes où la confiance, la justification et la responsabilité sont essentielles.

•Exemple : Si un système d’IA refuse un prêt à un individu, il est difficile pour cet individu de comprendre pourquoi, et pour la banque de justifier la décision si le modèle est une boîte noire. Cela peut entraîner un manque de confiance et des défis juridiques.

•Responsabilité : Qui est responsable en cas d’erreur ou de dommage causé par un système d’IA ? Est-ce le développeur, l’entreprise qui le déploie, l’utilisateur, ou l’IA elle-même ? Cette question est particulièrement pertinente pour les systèmes autonomes comme les véhicules sans conducteur.

•Exemple : En cas d’accident impliquant un véhicule autonome, la détermination de la responsabilité est complexe. Est-ce un défaut de conception du logiciel, une erreur de capteur, une défaillance matérielle, ou une décision imprévise de l’IA ? Les cadres juridiques actuels ne sont pas toujours adaptés à ces nouvelles réalités.

•Principes de l’IA Responsable : Pour adresser ces défis, des principes et des cadres pour une IA responsable sont en cours d’élaboration par des gouvernements, des organisations internationales et des entreprises. Ces principes incluent souvent :

•Équité et Non-discrimination : Assurer que l’IA traite tous les individus de manière juste.

•Transparence et Explicabilité : Rendre les décisions de l’IA compréhensibles et justifiables.

•Robustesse et Sécurité : Garantir que les systèmes d’IA sont fiables et résistants aux attaques.

•Confidentialité et Protection des Données : Respecter la vie privée et protéger les données personnelles.

•Responsabilité : Établir des mécanismes clairs pour l’attribution des responsabilités.

Ces considérations éthiques et de responsabilité sont essentielles pour garantir que l’IA soit développée et utilisée d’une manière qui serve le bien commun et respecte les valeurs humaines.

5.2. Interprétabilité et Explicabilité des Modèles

Alors que les modèles d’IA deviennent de plus en plus complexes et performants, la question de leur interprétabilité et de leur explicabilité devient cruciale. L’interprétabilité fait référence à la capacité de comprendre le fonctionnement interne d’un modèle, tandis que l’explicabilité concerne la capacité de justifier ses décisions de manière compréhensible pour un humain.

5.2.1. Pourquoi l’Interprétabilité est Cruciale

La nécessité de l’interprétabilité et de l’explicabilité des modèles d’IA découle de plusieurs facteurs :

•Confiance et Acceptation : Pour que les utilisateurs fassent confiance aux systèmes d’IA, ils doivent comprendre comment ces systèmes arrivent à leurs conclusions. Dans des domaines sensibles comme la médecine ou la justice, une décision d’IA non expliquée peut être perçue comme arbitraire et inacceptable.

•Exemple : Un médecin ne peut pas se fier aveuglément à un diagnostic d’IA s’il ne comprend pas les raisons sous-jacentes. Il a besoin de savoir quels symptômes ou quels résultats de tests ont conduit à cette conclusion pour valider le diagnostic et rassurer le patient.

•Détection et Correction des Biais : L’interprétabilité permet d’identifier et de corriger les biais algorithmiques. Si un modèle prend des décisions discriminatoires, l’explicabilité peut aider à comprendre pourquoi et à quel niveau du modèle le biais s’est introduit, facilitant ainsi sa correction.

•Exemple : Si un système de recrutement basé sur l’IA rejette systématiquement des candidatures féminines pour certains postes, l’analyse de l’explicabilité pourrait révéler que le modèle accorde une importance excessive à des mots-clés ou des parcours professionnels historiquement associés aux hommes, permettant ainsi d’ajuster les critères.

•Conformité Réglementaire : De plus en plus de réglementations (comme le RGPD en Europe avec le « droit à l’explication ») exigent que les décisions automatisées puissent être expliquées aux individus affectés. L’absence d’explicabilité peut entraîner des problèmes juridiques et de conformité.

•Amélioration des Modèles : Comprendre pourquoi un modèle réussit ou échoue permet aux développeurs d’améliorer ses performances. L’interprétabilité peut révéler des relations inattendues dans les données ou des erreurs dans la logique du modèle.

•Exemple : Si un modèle de prédiction météorologique fait des erreurs systématiques dans certaines conditions, l’analyse de son comportement interne pourrait montrer qu’il ne prend pas suffisamment en compte un certain facteur (par exemple, l’humidité du sol), ce qui permettrait d’affiner le modèle.

5.2.2. Méthodes d’Explicabilité (LIME, SHAP)

Plusieurs techniques ont été développées pour rendre les modèles d’IA plus explicables, en particulier les modèles complexes comme les réseaux de neurones profonds.

•LIME (Local Interpretable Model-agnostic Explanations) : LIME est une technique « agnostique au modèle », ce qui signifie qu’elle peut être appliquée à n’importe quel modèle d’apprentissage automatique. Elle génère des explications locales, c’est-à-dire qu’elle explique une seule prédiction du modèle en créant un modèle simple et interprétable (par exemple, une régression linéaire) autour de cette prédiction spécifique.

•Fonctionnement : Pour expliquer une prédiction, LIME perturbe l’entrée originale (par exemple, en masquant des parties d’une image ou en supprimant des mots d’un texte) et observe comment les prédictions du modèle changent. Il utilise ensuite ces paires (entrée perturbée, prédiction) pour entraîner un modèle local simple qui est facile à interpréter.

•Exemple : Pour une image où un CNN a identifié un chien, LIME pourrait mettre en évidence les pixels (par exemple, les oreilles, le museau) qui ont le plus contribué à la décision du modèle, en montrant quelles parties de l’image ont été les plus importantes pour la classification.

•SHAP (SHapley Additive exPlanations) : SHAP est une autre méthode agnostique au modèle qui attribue à chaque caractéristique d’entrée une valeur d’importance pour une prédiction donnée. Elle est basée sur les valeurs de Shapley issues de la théorie des jeux coopératifs, garantissant une répartition équitable de l’impact entre les caractéristiques.

•Fonctionnement : SHAP calcule la contribution marginale de chaque caractéristique à la prédiction du modèle, en considérant toutes les combinaisons possibles de caractéristiques. Cela permet de comprendre comment chaque caractéristique pousse la prédiction du modèle d’une valeur de base à la valeur de sortie finale.

•Exemple : Pour un modèle qui prédit le risque de défaut de paiement d’un prêt, SHAP pourrait montrer que le revenu annuel a un impact positif sur la prédiction (diminue le risque), tandis que le nombre de crédits en cours a un impact négatif (augmente le risque), et quantifier l’ampleur de ces impacts pour chaque demandeur.

Ces techniques, parmi d’autres, sont essentielles pour ouvrir la « boîte noire » des modèles d’IA, permettant une meilleure compréhension, une plus grande confiance et un développement plus responsable de l’intelligence artificielle.

5.3. L’Avenir des Agents d’IA et de l’Intelligence Artificielle Générale (AGI)

L’évolution rapide de l’IA soulève des questions fondamentales sur son avenir, notamment la possibilité d’atteindre une Intelligence Artificielle Générale (AGI) et l’impact profond que cela pourrait avoir sur la société et l’économie.

5.3.1. Vers l’Intelligence Artificielle Générale

Actuellement, la plupart des systèmes d’IA sont des « IA faibles » ou « IA étroites » (Narrow AI), c’est-à-dire qu’ils sont conçus et entraînés pour effectuer une tâche spécifique (par exemple, jouer aux échecs, reconnaître des visages, traduire des langues). L’Intelligence Artificielle Générale (AGI), en revanche, fait référence à une IA qui posséderait une intelligence comparable à celle d’un être humain, capable de comprendre, d’apprendre et d’appliquer ses connaissances à un large éventail de tâches, y compris celles qu’elle n’a jamais rencontrées auparavant.

•Caractéristiques de l’AGI : Une AGI serait capable de :

•Apprentissage Transférable : Appliquer des connaissances acquises dans un domaine à un autre.

•Raisonnement de Bon Sens : Comprendre et utiliser des connaissances implicites sur le monde.

•Créativité : Générer de nouvelles idées, œuvres d’art ou solutions.

•Autonomie et Auto-amélioration : Apprendre et s’améliorer continuellement sans intervention humaine.

•Défis et Perspectives : L’atteinte de l’AGI est l’un des plus grands défis de l’IA. Les chercheurs sont divisés sur le calendrier de son apparition, certains pensant que c’est une question de décennies, d’autres que c’est beaucoup plus lointain, voire impossible. Les défis incluent la modélisation de la conscience, de l’émotion, de l’intuition et de la capacité à apprendre de manière incrémentale et continue comme les humains.

•Exemple : Alors que les modèles de langage comme GPT-4 montrent des capacités impressionnantes de raisonnement et de génération de texte, ils ne possèdent pas de véritable compréhension du monde ni de conscience. Ils excellent dans les tâches pour lesquelles ils ont été entraînés, mais échouent souvent dans des tâches de bon sens ou nécessitant une compréhension profonde du monde physique ou social.

5.3.2. Impact Sociétal et Économique

L’avènement de l’AGI, ou même la poursuite des progrès de l’IA étroite, aura des répercussions profondes sur la société et l’économie.

•Transformation du Marché du Travail : L’automatisation par l’IA pourrait remplacer de nombreux emplois routiniers, mais aussi créer de nouveaux rôles et industries. La nécessité de la requalification et de l’amélioration des compétences (reskilling et upskilling) deviendra primordiale.

•Exemple : Les emplois dans la fabrication, la logistique et le service client sont déjà impactés par l’automatisation. Cependant, de nouveaux emplois liés à la conception, au déploiement, à la maintenance et à la supervision des systèmes d’IA émergent.

•Croissance Économique et Productivité : L’IA a le potentiel d’augmenter considérablement la productivité et de stimuler la croissance économique en optimisant les processus, en permettant de nouvelles découvertes et en créant de nouveaux produits et services.

•Exemple : L’IA dans la découverte de médicaments peut accélérer la recherche de nouvelles molécules, réduisant les coûts et le temps de développement. Dans l’agriculture, l’IA peut optimiser l’utilisation des ressources (eau, engrais) et augmenter les rendements.

•Défis Sociaux : Au-delà de l’emploi, l’IA soulève des questions sur la vie privée, la surveillance, la désinformation (deepfakes), et l’accentuation des inégalités si l’accès aux bénéfices de l’IA n’est pas équitablement réparti.

5.3.3. Recherche et Innovations Futures

La recherche en IA continue d’explorer de nouvelles frontières, avec plusieurs domaines prometteurs :

•Apprentissage Auto-Supervisé et Non Supervisé : Réduire la dépendance aux données étiquetées en permettant aux modèles d’apprendre à partir de grandes quantités de données non structurées.

•IA Explicable (XAI) : Développer des modèles qui peuvent expliquer leurs décisions de manière transparente, renforçant la confiance et la responsabilité.

•IA Robuste et Sûre : Rendre les systèmes d’IA plus résistants aux attaques adverses et plus fiables dans des environnements imprévisibles.

•IA Frugale : Développer des modèles d’IA qui nécessitent moins de données, moins de puissance de calcul et moins d’énergie, rendant l’IA plus accessible et durable.

•Neuro-symbolique AI : Combiner les forces de l’apprentissage profond (reconnaissance de motifs) avec le raisonnement symbolique (logique et règles) pour créer des systèmes plus robustes et interprétables.

•IA pour la Science : Utiliser l’IA pour accélérer la découverte scientifique dans des domaines comme la physique, la chimie, la biologie et la science des matériaux.